VIỆN CÔNG NGHỆ VÀ ĐÀO TẠO DEVMASTER

Đào tạo - Phần mềm - Cho thuê nhân sự

VIỆN CÔNG NGHỆ VÀ ĐÀO TẠO DEVMASTER

Đào tạo - Phần mềm - Cho thuê nhân sự

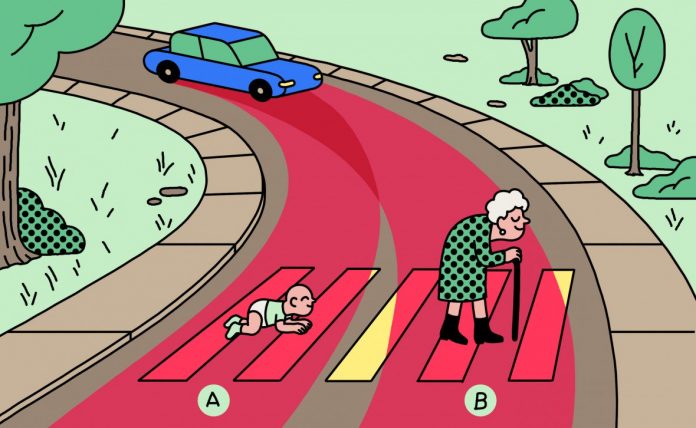

Khi đứng giữa 2 lựa chọn: làm 3 nữ hành khách thiệt mạng khi đâm vào rào chắn hay đâm vào những đứa trẻ đang băng qua đường, thì một chiếc xe tự lái sẽ lựa chọn như thế nào?

Khi suy nghĩ về tương lai của những chiếc xe tự lái, ba nhà nghiên cứu người Mỹ đã đặt ra câu hỏi: bằng cách nào những chiếc xe này sẽ đưa ra những quyết định về đạo đức mà con người thường đưa ra một cách đầy chủ quan. Chính vì thế Jean-François Bonnefon, Azim Shariff, và Iyad Rahwan đã nảy ra ý tưởng thiết kế những câu hỏi online mang tên là The Moral Machine. Bạn sẽ đâm vào một người đàn ông hay phụ nữ? Một người trưởng thành hay trẻ em? Một con chó hay một con người? Một nhóm hay một cá nhân?

Đến năm 2069, những phương tiện tự vận hành chính là một bước tiến vượt trội trong giao thông kể từ khi mẫu T Ford được ra mắt tại Detroit vào năm 1908. Mặc dù có đến 62 công ty được cấp giấy phép thử nghiệm những chiếc xe tự lái nhưng có vẻ ngành công nghiệp này chưa sẵn sàng để đối mặt với những vấn đề mang tính đạo đức. The Moral Machine được thiết kế để giúp cho một người bình thường có một cái nhìn sâu sắc về mặt đạo đức của máy móc, giúp họ bày tỏ quan điểm của mình khi mà tiếng nói của họ bị hạn chế bởi các nhà làm luật, nhà sản xuất ôtô, các nhà triết học trong cuộc tranh luận về vấn đề này. Medium đã có một cuộc phỏng vấn với Bonnefon và Shariff về các kết quả rút ra được từ nghiên cứu của họ về một vấn đề hóc búa trong tương lai: máy móc và đạo đức.

Có thể bạn muốn xem:

Một số mẹo để bắt đầu với Machine Learning

Làm kỹ sư AI, mức lương 500 triệu là bình thường

Medium: Đâu là sự khác biệt trong việc đưa ra quyết định mang tính đạo đức giữa con người và máy móc?

Jean-François Bonnefon: Để đưa ra một quyết định mang tính đạo đức con người thường bị chi phối bởi rất nhiều yếu tố khác nhau. Chúng ra phản ứng dựa vào các hormones cơ bản nhất chứ không phải là một lý do nào nó đặc biệt là khi phải đưa ra những quyết định thật nhanh. Tôi và bạn có thể ngồi lại với nhau để dành một giờ để quyết định cách phản ứng mà chúng ta mong muốn, nhưng chúng ta không thể nào lập trình nó bởi vì nó là bản năng. Đối với máy móc, chúng ta có thể cho chúng biết nên làm gì.

Azim Shariff: Máy móc luôn có sự tính toán và suy xét tốt nhất mà đối với chúng ta đôi khi đó là một điều “xa xỉ”

Medium: The Moral Machine đã giúp các bạn đưa ra kết luận thế nào về cách chúng ta mong muốn máy móc hành động?

Azim Shariff: Ở tất cả các quốc gia đều dành sự ưu tiên của mình để cứu những người trẻ thay vì người già và hầu hết lựa chọn sẽ cứu phụ nữ thay vì đàn ông. Các ưu tiên này ở các quốc gia đều có vẻ giống nhau nhưng sự khác biệt chính là sự chắc chắn về lựa chọn của mình ở từng quốc gia. Ở các nước phương Đông, ví dụ như sự ưu tiên cứu người già thay vì người trẻ ở Nhật Bản là rất ít. Còn ở các quốc gia phương Tây thì ngược lại.

Jean-François Bonnefon: Sẽ thú vị hơn rất nhiều nếu chúng ta nhìn vào các yếu tố kinh tế vĩ mô. Ở tất cả các quốc gia đều cho thấy sự ưu tiên của họ dành cho những người thuộc tầng lớp cao hơn (ví dụ như sự ưu tiên hơn dành cho giám đốc điều hành so với người vô gia cư). Chúng tôi nhận thấy rằng điều này có liên quan mật thiết với mức độ bất bình đẳng của nền kinh tế quốc gia đó. Nơi nào có sự bất bình đẳng càng lớn thì quốc gia đó càng ưu tiên việc hy sinh những người thuộc tầng lớp thấp hơn .

Medium: Mức độ quan tâm của những nhà sản xuất xe tự lái tới kết quả nguyên cứu của các bạn như thế nào?

Azim Shariff: Đây là một câu hỏi vô cùng quan trọng. Liệu chúng ta có nên nghe theo những gì được rút ra từ nghiên cứu này? Chúng ta sẽ thỏa mãn họ nếu số đông mong muốn điều đó? Có lẽ sẽ hữu ích hơn nếu chúng ta lắng nghe những người được đào tạo để suy nghĩ về các vấn đề đạo đức. Việc chúng ta biết được những gì cộng đồng suy nghĩ là vô cùng hữu ích nhưng không nên chỉ nghe theo ý kiến số đông. Nó “dẫn đường” cho chúng ta suy nghĩ lại về vấn đề đạo đức khi lập trình cho những chiếc xe tự lái này.

Medium: Trong những nghiên cứu trước đây, các bạn đã kết luận rằng con người sẽ lựa chọn cứu số đông cho dù phải hy sinh những hành khách trên xe. Nhưng họ cũng sẽ nói không với những chiếc xe tự lái được lập trình như thế. Điều này mang ý nghĩa gì?

Azim Shariff: Nhìn chung con người đều đề cao giá trị đạo đức khi cho rằng việc cứu nhiều mạng người hơn là đúng đắn. Nhưng không một ai là không quý trọng mạng sống của mình nên những sản phẩm hoạt động dựa theo lý thuyết trên sẽ rất khó bán được. Mercedes-Benz đã vấp phải sự phẫn nộ của công chúng khi tuyên bố họ sẽ cứu tính mạng của người lái xe thay vì người đi bộ. Phát ngôn này đã phải rút lại ngay sau đó. Điều này cho thấy những các công ty xe hơi phải giải quyết một bài toán hóc búa, thật khó để vẹn cả đôi đường. Bạn sẽ bị phản đối từ cộng đồng nếu quyết định ưu tiên hành khách trên xe nhưng lại bị tẩy chay nếu không may xảy ra tai nạn nguy hiểm đến tính mạng khi lựa chọn sự bình đẳng giữa mọi người. Các nhà sản xuất xe mà chúng tôi đã trao đổi đều mong muốn pháp luật sẽ giải quyết vấn đề này chứ không phải từ quyết định của họ.

Medium: Liệu chính phủ Mỹ có nên đi theo con đường của Đức để ban hành những hướng dẫn về đạo đức cho xe tự lái?

Azim Shariff: Tôi nghĩ đây là một “ý tưởng tuyệt vời”. Khi chính phủ khi tham gia vào việc này sẽ ngăn được việc thị trường tự quyết định tính đạo đức của những chiếc xe tự lái. Việc mỗi nhà sản xuất tự đưa ra hướng dẫn riêng của mình để khách hàng lựa chọn sẽ dẫn đến sự hỗn loạn.

Medium: Các giá trị của con người sẽ đồng đều hơn để sớm thống nhất theo một định hướng chung cho tất cả các quốc gia?

Azim Shariff: Việc này hoàn toàn khả thi. Chúng ta thường đồng tình với nhau dựa trên các quan điểm chung nhất, chẳng hạn như việc cứu nhiều người là tốt hơn. Nhưng cũng sẽ có những quan điểm trái ngược nhau ví dụ như ta nên hành động như thế nào với người đang đi bộ. Ở Nhật Bản người ta thường ít đi bộ hơn nhưng ở Delhi hay New York thì điều này rất phổ biến. Có thể đây là điều khó khăn và những chiếc xe phải đáp ứng bằng cách nào đó.

Theo tôi điều này không thực sự cần thiết cho dù chúng ta có thể đạt được sự đồng thuận chung đi chăng nữa. Đơn giản như việc tôi đã phải sửa đổi đèn pha chiếc xe của mình khi mang nó đến Mỹ từ Canada. Để thay đổi phần cứng sẽ khó hơn đối với phần mềm. Với phần mềm trên xe tự lái, ta có thể thay đổi thuật toán để phù hợp với các quy định ở bản địa.

Medium: Một kỹ sư đang làm việc cho dự án xe tự lái của Google cho rằng các kết quả trong nghiên cứu của các bạn là không cần thiết bởi câu trả lời cho trường hợp này là nhấn phanh. Liệu tình huống đưa ra bởi The Moral Machine có phù hợp trên thực tế?

Azim Shariff: Những tình huống như vậy sẽ rất ít khi xảy ra. Điều quan trọng liên quan ở đây chính là những quyết định dù nhỏ nhất mà chiếc xe đưa ra sẽ ảnh hưởng như thế nào tới việc thay đổi các rủi ro. Nếu ưu tiên lũ trẻ hơn, quyết định đó sẽ khiến người trên xe gặp nguy hiểm. Dù quyết định này có thể sẽ không mang đến hậu quả nghiêm trọng nhưng câu hỏi tiếp tục được đặt ra đối với chúng ta đó là xe tự lái sẽ phân chia nguy cơ như thế nào giữa mọi người, hành khách trên xe và lũ trẻ đang đi bộ. Câu hỏi đó ngày càng trở nên phức tạp nhưng lại vô cùng cần thiết.

Devmaster via Medium